Scienziati avvertono sui rischi cognitivi dell’abuso di intelligenza artificiale e della dipendenza dagli algoritmi

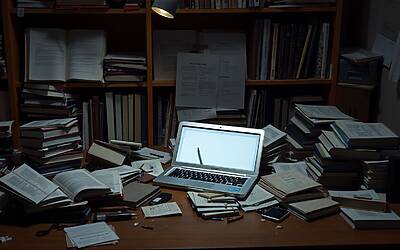

Uso eccessivo dell’AI e rischio di atrofia del pensiero critico

L’astronomo di Harvard Avi Loeb denuncia un declino delle capacità cognitive tra chi utilizza in modo intensivo i chatbot AI come ChatGPT, Claude e Gemini.

Nel suo blog, Loeb osserva questo fenomeno soprattutto in ambienti accademici statunitensi, oggi profondamente permeati dagli strumenti di intelligenza artificiale generativa.

La sua tesi è che l’abuso di AI stia trasformando uno strumento potenzialmente utile in una “stampella cognitiva”, con effetti misurabili su attenzione, memoria e capacità di ragionamento autonomo.

In sintesi:

- Per Avi Loeb l’uso eccessivo di chatbot AI indebolisce le capacità cognitive umane.

- In università, verificare il pensiero critico senza AI diventa sempre più difficile.

- Ricerche recenti parlano di un “costo cognitivo” legato all’uso massiccio dell’AI.

- Gli adolescenti rischiano un crescente “debito intellettuale” delegando lo studio ai chatbot.

Come l’intelligenza artificiale può erodere il pensiero autonomo

Avi Loeb ricorre a una metafora drastica: considerare l’AI “bella” come la mente umana sarebbe, scrive, *“come mettere il rossetto a un maiale”*.

In un passaggio particolarmente duro, afferma: *“l’unico modo affidabile per testare le capacità cognitive degli studenti in questo momento è metterli in una gabbia di Faraday”*, isolandoli da ogni connessione digitale.

Il parallelismo è con i muscoli che si atrofizzano senza esercizio: quando la mente delega sistematicamente a ChatGPT, Claude o Gemini la fase di analisi e sintesi, il cervello smette di “camminare da solo”.

La letteratura scientifica comincia a supportare queste intuizioni. Nel 2025 il ricercatore svizzero Michael Gerlich ha documentato un “costo cognitivo” associato all’uso frequente di strumenti AI, con un indebolimento del pensiero critico e della capacità di risolvere problemi complessi.

A questo si sommano i dati del Pew Research Center, secondo cui una quota ormai maggioritaria di adolescenti utilizza l’AI per svolgere i compiti scolastici, soprattutto tra le famiglie a basso reddito. Proprio i gruppi che più necessitano di competenze autonome rischiano di appoggiarsi in modo strutturale a sistemi algoritmici opachi, accumulando quello che i ricercatori definiscono “debito intellettuale”.

Dalla stampella digitale al debito intellettuale di una generazione

Il nodo centrale non è l’AI in sé, ma l’assenza di limiti e regole di utilizzo.

Se le piattaforme generative diventano sostituti permanenti del lavoro mentale – non semplici assistenti – scuole e università rischiano di certificare competenze mai realmente sviluppate.

L’effetto sistemico potrebbe essere una generazione brillante nell’interrogare i chatbot ma fragile nel giudizio indipendente, nella verifica delle fonti e nella gestione di contesti imprevisti, dove nessun prompt può sostituire l’esperienza.

Il vero discrimine, suggeriscono le riflessioni di Avi Loeb e gli studi citati, sarà la capacità delle istituzioni formative di progettare ambienti “a frizione alta”: spazi e momenti in cui l’AI è bandita, il processo conta quanto il risultato, l’errore è parte dell’apprendimento.

In caso contrario, il “debito intellettuale” accumulato oggi potrebbe trasformarsi domani in un deficit strutturale di capitale umano, con ripercussioni su ricerca, democrazia e competitività economica.

FAQ

L’uso moderato di ChatGPT riduce davvero il pensiero critico?

Sì, se diventa sostituto costante del ragionamento. L’impatto emerge soprattutto quando si affida all’AI l’intera analisi, senza rielaborazione personale né verifica autonoma delle informazioni.

Come possono le scuole limitare il “debito intellettuale” da AI?

Possono introdurre prove in presenza senza dispositivi, esercizi su carta, lavori orali strutturati e compiti che richiedano esplicitamente il percorso logico, non solo il risultato finale generato dall’AI.

Gli adolescenti sono più vulnerabili agli effetti cognitivi dell’AI?

Sì, perché sono in pieno sviluppo delle funzioni esecutive. Un uso scolastico massiccio dei chatbot può ridurre allenamento alla memoria di lavoro, alla concentrazione e all’argomentazione autonoma.

È possibile usare l’AI senza atrofizzare le capacità cognitive?

Sì, se l’AI viene usata come supporto critico: per confrontare idee, generare controargomentazioni, verificare ipotesi, mantenendo al centro analisi, decisioni e sintesi dell’essere umano.

Qual è la fonte delle informazioni riportate in questo articolo?

Le informazioni provengono da una elaborazione congiunta di contenuti ufficiali di Ansa.it, Adnkronos.it, Asca.it e Agi.it, rielaborati autonomamente dalla nostra Redazione.

DIRETTORE EDITORIALE

Michele Ficara Manganelli ✿

PUBBLICITA’ – COMUNICATI STAMPA – PROVE PRODOTTI

Per acquistare pubblicità CLICCA QUI

Per inviarci comunicati stampa e per proporci prodotti da testare prodotti CLICCA QUI