YouTube invita gli utenti a identificare e segnalare i contenuti generati dall’intelligenza artificiale di bassa qualità

Indice dei Contenuti:

YouTube testa il feedback degli utenti contro i video AI di bassa qualità

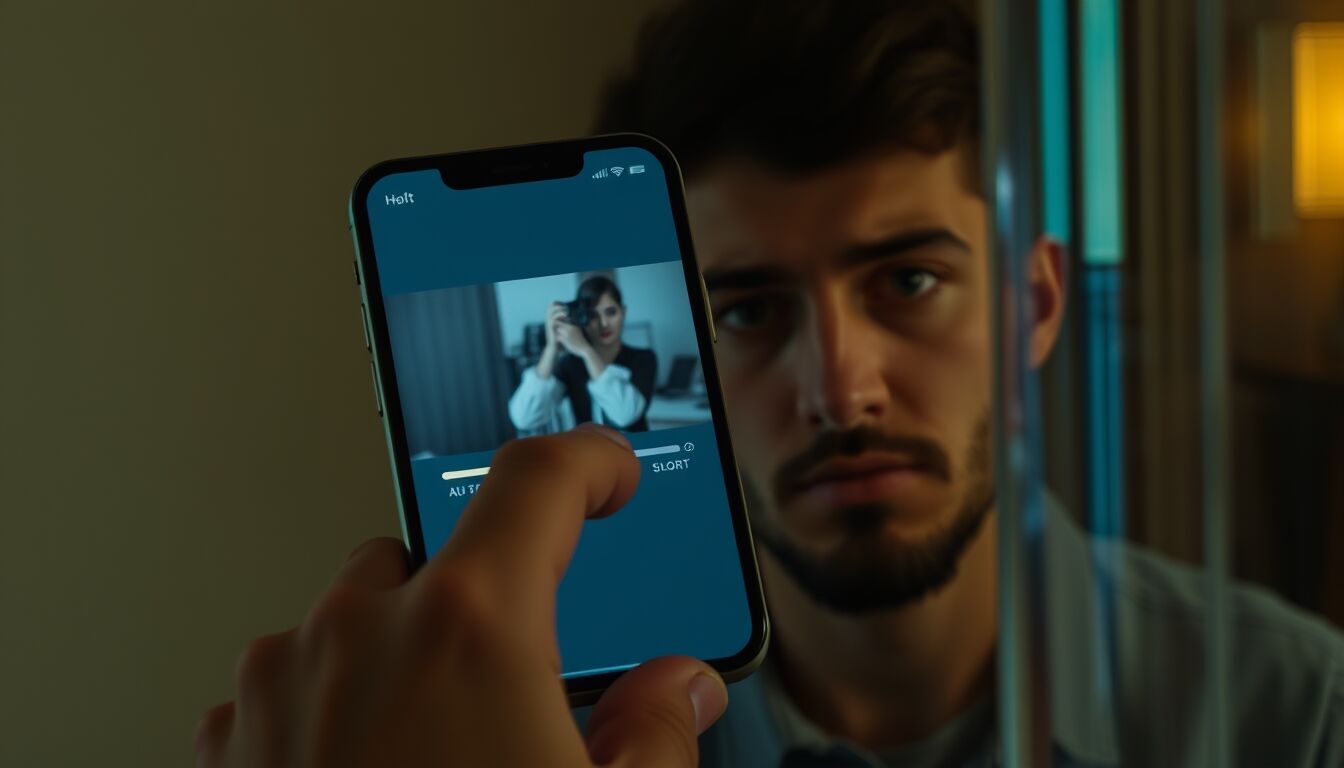

YouTube sta sperimentando un nuovo strumento per contrastare l’“AI slop”, ovvero i contenuti generati da intelligenza artificiale poveri e ripetitivi.

Il test, attivo da questo mese su un campione di utenti globali, introduce un pop-up che chiede: *“Did this feel like AI slop?”*.

L’obiettivo dichiarato è capire come gli spettatori percepiscono i video brevi, soprattutto nei YouTube Shorts, dove il fenomeno è più evidente e spesso arriva anche ai bambini.

Il questionario offre più livelli di risposta, da “Per niente” a “Estremamente”, per misurare con precisione la sensazione di “spazzatura AI”.

La mossa apre però interrogativi: YouTube vuole solo ripulire la piattaforma o usare questi dati per addestrare meglio i propri modelli generativi?

In sintesi:

- YouTube testa un pop-up che chiede se un video sembra “AI slop”.

- Il fenomeno colpisce soprattutto i YouTube Shorts e i profili non loggati.

- I dati potrebbero servire a ridurre contenuti scadenti o a migliorare l’AI.

- La questione riguarda in particolare l’esposizione dei bambini ai video brevi.

Come funziona il pop-up e perché riguarda soprattutto gli Shorts

Il pop-up, segnalato da utenti su Reddit e riportato da Dexerto, appare sotto alcuni video con la domanda diretta: *“Did this feel like AI slop?”*.

Le opzioni vanno da “Per niente” a “Estremamente”, passando per livelli intermedi come “Leggermente”, “Moderatamente” e “Molto”.

La scelta lessicale è insolitamente esplicita per YouTube, segno di una consapevolezza interna sulla saturazione di contenuti generati automaticamente.

Il problema è particolarmente evidente nei YouTube Shorts visualizzati in modalità anonima: l’algoritmo propone una sequenza di video ultra-virali, spesso prodotti in massa tramite AI, con narrazioni generiche, immagini sintetiche e clip riciclate.

Questi contenuti finiscono di frequente nel feed di profili usati da minori, sommando il tema “bassa qualità” a quello, già critico, della tutela dei bambini nelle piattaforme di video brevi.

In passato, YouTube ha già chiuso canali basati quasi esclusivamente su contenuti generati dall’AI, motivando i ban con la necessità di ridurre “contenuti ripetitivi e di scarsa qualità”.

Dati per ripulire la piattaforma o per rafforzare i modelli AI?

La lettura più lineare del test è positiva: usare il feedback degli utenti per demotare i video classificati come “AI slop” e favorire i contenuti originali, specie quelli umani.

In questa logica, i pop-up di segnalazione diventerebbero un ulteriore segnale di ranking, utile a migliorare le raccomandazioni in home, Shorts e Discover di YouTube.

Dexerto evidenzia però uno scenario alternativo: la scala graduata del questionario fornisce dati preziosi su come il pubblico percepisce i diversi livelli di artificiosità.

Con queste informazioni, YouTube potrebbe addestrare i propri modelli di generazione video per produrre contenuti sintetici sempre meno riconoscibili come tali, ottimizzando i parametri finché l’utente medio non li considera più “spazzatura”.

Se i video generati diventano indistinguibili da quelli reali, la linea tra contenuto autentico e prodotto algoritmico si assottiglia ulteriormente, con implicazioni rilevanti per la trasparenza informativa, la fiducia degli utenti e la credibilità stessa della piattaforma.

Quali scenari futuri per creator, utenti e regolatori

L’esperimento sull’“AI slop” anticipa una fase in cui il ruolo degli utenti come “sensori di qualità” diventerà centrale nelle piattaforme video.

Per i creator, questo potrebbe tradursi in una penalizzazione degli output seriali, generati solo per sfruttare l’algoritmo, e in una valorizzazione di format più originali, dichiaratamente umani o quantomeno trasparenti sull’uso dell’AI.

Per gli utenti, soprattutto famiglie e insegnanti, il tema cruciale sarà la possibilità di controllare meglio l’esposizione dei minori ai contenuti AI, attraverso filtri, impostazioni dedicate e maggiore chiarezza nelle etichette dei video.

Sul fronte regolatorio, la capacità di distinguere tra “AI di bassa qualità” e “AI indistinguibile dal reale” potrebbe entrare nel dibattito su norme, etichettature obbligatorie e responsabilità delle piattaforme nella gestione dei contenuti sintetici.

FAQ

Cosa significa esattamente il termine AI slop su YouTube?

Indica contenuti generati con intelligenza artificiale prodotti in massa, con scarso valore creativo, ripetitivi, pensati solo per engagement e monetizzazione rapida.

Come capire se un video YouTube è stato generato con intelligenza artificiale?

È possibile riconoscerlo osservando voci sintetiche, immagini incoerenti, narrazioni generiche, assenza di dettagli specifici e canali che pubblicano decine di video quasi identici.

I bambini possono essere esposti a molti contenuti AI slop su YouTube?

Sì, soprattutto nei YouTube Shorts e sui profili non loggati, dove l’algoritmo propone contenuti virali spesso generati automaticamente e non sempre adatti ai minori.

Questo nuovo pop-up influenzerà la visibilità dei video dei creator?

Probabilmente sì: un forte feedback negativo potrebbe diventare un segnale per ridurre la distribuzione di video percepiti come “AI slop” dagli utenti.

Da quali fonti è stata elaborata questa analisi su YouTube e AI slop?

È stata elaborata congiuntamente a partire da informazioni e notizie di Ansa.it, Adnkronos.it, Asca.it e Agi.it, poi rielaborate dalla nostra Redazione.