Durov e gli Accusati di Complicità nei Contenuti Illegali su Telegram

La notizia dell’arresto di Pavel Durov, CEO di Telegram, ha segnato un momento cruciale per la piattaforma, che ha sempre promosso la privacy e la sicurezza delle comunicazioni. Tuttavia, l’indagine della Procura di Parigi mette in discussione se questa protezione possa coesistere con la responsabilità di fronte ad accuse gravi di complicità in comportamenti illeciti. Le recenti rivelazioni evidenziano le preoccupazioni di un pubblico sempre più ansioso riguardo ai contenuti illegalmente veicolati nelle piattaforme digitali.

Telegram, concepito come uno spazio sicuro per le comunicazioni private, si trova ora al centro di un dibattito etico e legale per cui la separazione tra privacy e legalità sta diventando sempre più sfumata. Gli utenti desiderano un ambiente in cui le loro conversazioni siano protette, ma al contempo temono che questa stessa riservatezza possa essere sfruttata per perpetrare reati criminali. La fiducia delle persone nelle piattaforme social è in gioco e le domande etiche si fanno più pressanti.

Le accuse nei confronti di Durov non sono da prendere alla leggera. Con un numero crescente di utenti su Telegram, la piattaforma è stata anche associata a contenuti problematici, che variano dalla condivisione di materiale pedopornografico al traffico di droga. Gli inquirenti si trovano ora di fronte a un dilemma: come bilanciare la necessità di garantire la privacy degli utenti con l obbligo di prevenire e combattere i crimini che attraverso la stessa piattaforma possono trovare spazio?

La situazione attuale riflette una realtà complessa, in cui i CEO delle piattaforme digitali devono affrontare non solo la gestione delle proprie aziende, ma anche le responsabilità sociali legate alle loro scelte operative. Il messaggio che emerge è chiaro: è essenziale che le piattaforme siano in grado di garantire non solo uno spazio di libertà per le comunicazioni ma anche un ambiente sicuro per tutti gli utenti.

È un momento difficile per molti, da un lato sostenendo il diritto alla privacy, dall’altro, contribuendo attivamente alla prevenzione di abusi e crimini. La conversazione è solo all’inizio, e ci saranno ulteriori sviluppi che plasmeranno il futuro della messaggistica online e della responsabilità delle piattaforme nel garantire un ambiente giusto e sicuro per tutti.

Arresto di Durov e Implicazioni Legali

Il processo di arresto di Pavel Durov, avvenuto in circostanze che sollevano molteplici interrogativi, ha messo sotto i riflettori le complesse interazioni tra privacy, responsabilità aziendale e legalità nel panorama digitale moderno. L’arresto, avvenuto nel contesto di un’indagine condotta dalla Procura di Parigi, solleva una serie di questioni legali che potrebbero avere un impatto duraturo non solo su Durov, ma anche sugli utenti e le piattaforme di messaggistica in generale.

Le implicazioni legali dell’arresto di Durov sono significative. Così come definito nel Digital Services Act (DSA), i fornitori di servizi come Telegram hanno obblighi specifici in materia di contenuti illegali. La non conformità a questi obblighi ha portato ad una misura draconiana, come l’arresto di un CEO, un evento raro nel settore. Ciò solleva interrogativi sul futuro della gestione delle piattaforme e su come queste risponderanno alle richieste delle autorità, specialmente in situazioni in cui il diritto alla privacy degli utenti è in conflitto con la sicurezza pubblica.

Il DSA stabilisce che, al ricevimento di un ordine dalle autorità per contrastare contenuti illegali, le piattaforme devono rispondere tempestivamente. Questo aspetto, sebbene giustificato dalla necessità di combattere attivamente crimini come la pedopornografia e il traffico di droga, pone anche delle criticità. Si teme che un’applicazione eccessiva di tali obblighi possa creare una sorta di sorveglianza non desiderata, eludendo i diritti alla riservatezza degli utenti.

Il caso di Durov rappresenta quindi un campanello d’allarme. Il dibattito attuale si concentra su come le piattaforme di messaggistica possano mantenere la loro missione di garantire privacy e sicurezza, senza diventare complici di comportamenti illeciti. Potrebbe essere necessaria una revisione delle normative in materia di contenuti digitali, affinché si possano trovare soluzioni che equilibri i diritti alla privacy con la necessità di affrontare attivamente i crimini.

L’arresto di un leader come Durov, che ha costruito la sua reputazione sulla difesa della privacy degli utenti, accresce la complessità di questa situazione. Ogni decisione che le piattaforme prendono ora potrebbe avere ripercussioni significative su come gli utenti percepiscono la sicurezza e la trasparenza delle loro comunicazioni. Le prossime mosse legali e i procedimenti giudiziari non soltanto influenzeranno Durov e Telegram, ma potrebbero anche segnare il tono della dialogo sull’etica e l’operatività delle piattaforme digitali in Europa e nel mondo.

Le parole chiave di questa situazione sono responsabilità, trasparenza e collaborazione. È cruciale che le piattaforme non solo comprendano la legge, ma anche la necessità di operare in modi che rispettino gli utenti e gli standard di sicurezza pubblica. L’esito di questo processo e le decisioni future delle piattaforme potrebbero stabilire un precedente importante per la protezione degli utenti e il contrasto dei contenuti illegali sul web.

Accuse contro Pavel Durov

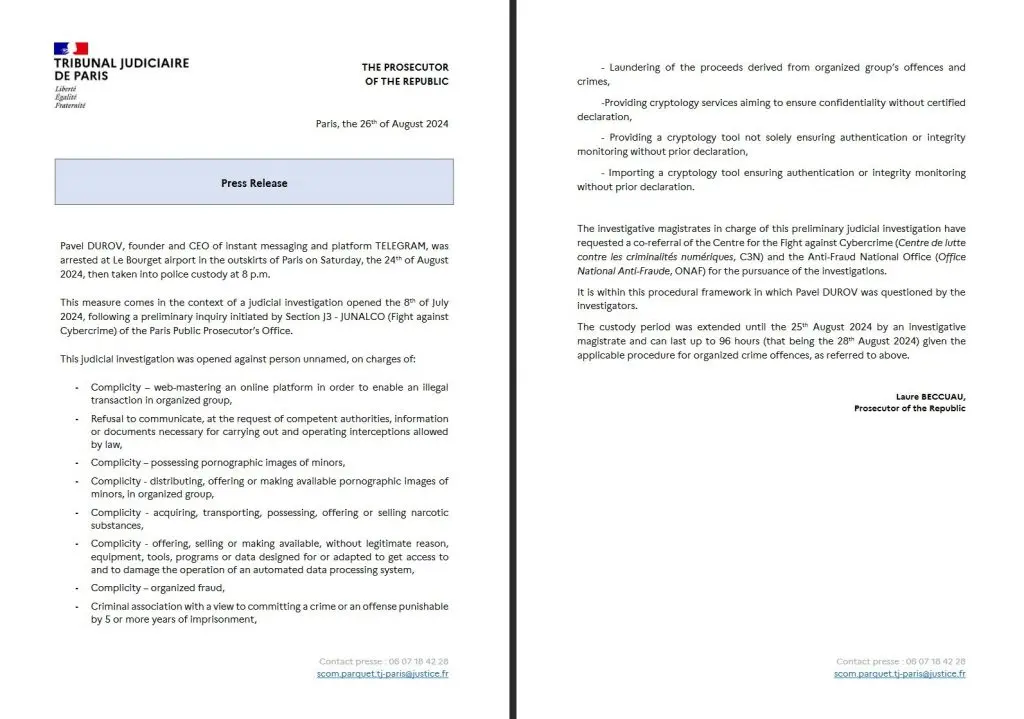

Le accuse lanciate contro Pavel Durov assumono contorni allarmanti e rappresentano un nodo cruciale nel dibattito sulla regolamentazione delle piattaforme di messaggistica. Le accuse emerse dall’indagine della Procura di Parigi non riguardano solo la presunta inazione di Durov nei confronti di contenuti illeciti, ma si spingono fino a definirlo un “complice” in reati gravissimi come la condivisione di materiale pedopornografico, il traffico di droga e il riciclaggio di denaro. Suddividere la gravità di queste accuse è essenziale per comprendere le potenziali conseguenze legali che il CEO di Telegram potrebbe affrontare.

La responsabilità di moderare i contenuti su una piattaforma così ampia come Telegram non è un compito semplice, ma l’assenza di misure concrete per impedire la diffusione di materiale illecito ha portato a interrogativi sul grado di responsabilità che i leader delle piattaforme devono assumersi. Le accuse di Durov pongono l’accento su un aspetto fondamentale: la protezione degli utenti e la lotta contro i contenuti pericolosi devono coesistere per mantenere la fiducia del pubblico nei servizi digitali. La mancanza di collaborazione con le autorità francesi, secondo l’accusa, ha contribuito a intensificare questa crisi di fiducia.

Un altro punto cruciale riguarda la definizione di ‘complicità’. Gli esperti legali sotto i riflettori discutono su cosa significhi esattamente essere complici in questo contesto. È l’assenza di azioni preventive da parte di una piattaforma illecita? O è la mancanza di reazioni tempestive alle richieste delle autorità? Questo aspetto legale si fa sempre più confuso in un ambiente dove la velocità della comunicazione supera spesso la capacità delle normative di adattarsi.

In questo contesto, Durov non è solo un imprenditore di successo, ma ora si trova a dover difendere la sua visione di una piattaforma che promuove la libertà di espressione e la riservatezza. La sua posizione è complicata da pressioni esterne crescenti per contrastare contenuti problematici. Alcuni esperti sottolineano che la sua difesa verterà sulla distinzione tra essere un fornitore di servizi e assumere un ruolo attivo nella supervisione dei contenuti.

È chiaro che questo è un momento decisivo non solo per Durov, ma anche per l’intero settore delle tecnologia. Il rischio è che il precedente stabilito in questo caso influenzerà come i CEO delle piattaforme si comporteranno in futuro nel bilanciare gli aspetti della privacy degli utenti con l’efficace moderazione dei contenuti. Le conclusioni a cui si giungerà potrebbero avviare un cambiamento radicale nel modo in cui funzionano le piattaforme di messaggistica e, più in generale, come i diritti digitali vengono interpretati e implementati.

Dettagli dell’Investigazione

L’indagine che ha portato all’arresto di Pavel Durov è complessa e coinvolge diverse entità e una serie di reati gravi. Iniziata ufficialmente il 8 luglio 2024, la Procura di Parigi ha focalizzato la sua attenzione su un presunto utilizzo di Telegram per la diffusione di contenuti illeciti, inclusi reati particolarmente odiosi come la pedopornografia e il traffico di droga. Questo approccio investigativo ha rivelato un panorama inquietante in cui la piattaforma, incentrata sulla privacy, viene vista ora come un rifugio per attività criminali.

Durante le indagini, gli inquirenti hanno identificato un gruppo specifico su Telegram come il fulcro delle operazioni illecite, dove si sospetta che materiale compromettente e altre informazioni siano state scambiate senza alcun controllo. Ciò ha sollevato domande cruciali su quali misure di moderazione e sicurezza siano state implementate dalla piattaforma e se queste siano state sufficienti per prevenire l’abuso del servizio.

Un aspetto importante dell’indagine è stato il tentativo di ottenere la cooperazione di Telegram. Le autorità francesi hanno ripetutamente richiesto assistenza nella moderazione di contenuti e nella rimozione di utenti che operano per scopi dannosi. La risposta di Telegram, secondo quanto riportato, è stata insufficiente, alimentando l’idea che l’azienda non stesse prendendo sul serio le proprie responsabilità. Questo ha portato i pubblici ministeri a classificare Durov non solo come un imprenditore tecnologico, ma come una figura intricata in un caso legale con implicazioni di vasto respiro.

I dettagli dell’indagine sono una combinazione complicata di azioni intelligenti e la necessità di affrontare in tempo reale l’emergere di contenuti inappropriati su una piattaforma di messaggistica così diffusa. Le autorità stanno esaminando non solo la quantità di contenuti problematici, ma anche le politiche di Telegram sul monitoraggio e sulla moderazione. Quali strumenti ha la piattaforma per identificare e rimuovere contenuti dannosi? Quale responsabilità deve assumersi per garantire che la privacy degli utenti non venga violata, pur promuovendo un ambiente sicuro per tutti?

L’arresto di Durov ha generato un’ondata di discussioni sui limiti della libertà di espressione nelle piattaforme digitali. Ci si domanda se i diritti degli utenti possano forse essere sfruttati dai criminali senza conseguenze. Gli esperti invitano a riflettere sull’importanza di un equilibrio: come possono le piattaforme garantire la privacy degli utenti mentre collaborano attivamente per fermare abusi e criminalità? È un dilemma che è al centro stesso della sfida per molte aziende tecnologiche oggi.

Senza dubbio, i dettagli dell’indagine su Durov e Telegram saranno seguiti con grande attenzione, non solo per le ripercussioni immediate sul fondatore e sul suo team, ma anche per il futuro delle politiche di moderazione nella messaggistica. L’epilogo di questo caso potrebbe influenzare il modo in cui i servizi digitali interagiscono con le autorità e i protocolli che determineranno come soppesare la privacy con la necessità di garantire la sicurezza e la legalità negli spazi online.

Risvolti del DSA sulla Responsabilità delle Piattaforme

Il Digital Services Act (DSA) sta rapidamente emergendo come un elemento cruciale nel panorama giuridico europeo, stabilendo parametri chiari su come le piattaforme digitali debbano operare in relazione ai contenuti illegali. La situazione di Pavel Durov e l’arresto del CEO di Telegram hanno illuminato le implicazioni di queste normative, ponendo interrogativi sulla loro applicazione e sull’equilibrio tra responsabilità delle piattaforme e diritti degli utenti.

Il DSA è stato concepito con l’intento di garantire un ambiente online più sicuro e responsabile. All’interno di questo quadro legislativo, le piattaforme hanno obblighi ben definiti riguardo alla moderazione dei contenuti. Se da un lato quest’azione è necessaria per combattere il proliferare di contenuti nocivi, dall’altro solleva preoccupazioni circa il rischio di una sorveglianza eccessiva. L’arresto di Durov può essere interpretato come un campanello d’allarme per tutti quei dirigenti che governano piattaforme non solo di messaggistica, ma anche in ambito sociale e commerciale.

Le responsabilità legali delineate dal DSA non solo seguono un ordine di contrasto a contenuti illegali, ma richiedono anche una comunicazione tempestiva e una cooperazione attiva da parte delle piattaforme stesse. Nel caso di Telegram, l’accusa di non aver risposto in modo adeguato alle richieste delle autorità francesi ha sollevato questioni sulla loro effettiva attuazione delle politiche di sicurezza. Questo apre una discussione più ampia sulle modalità di monitoraggio e di azione preventiva in un contesto dove la privacy degli utenti è una priorità.

Molti esperti concordano sul fatto che il DSA deve trovare un equilibrio tra la protezione dei diritti individuali e la necessità di garantire un ambiente online privo di reati. La definizione di “complicità” nella diffusione di contenuti illecito implica una responsabilità attiva da parte dei fornitori di servizi, sollevando interrogativi su quanto gli stessi possano essere ritenuti colpevoli per i crimini commessi da alcuni dei loro utenti. In questo contesto, la linea tra protezione della privacy e cooperazione con le forze dell’ordine diventa soggetta a interpretazioni legali basilari.

Le ripercussioni di queste dinamiche vanno ben oltre la figura di Durov e Telegram. Le aziende stanno affrontando una pressione crescente per stabilire manovre di moderazione più efficaci, nel tentativo di evitare problemi legali come quelli che ha affrontato il fondatore di Telegram. Ciò potrebbe portare alla modifica delle politiche interne delle piattaforme, includendo tecnologie più sofisticate per la rilevazione di contenuti problematici e un dialogo aperto con le autorità competenti.

Il DSA ha quindi il potere di trasformare il modo in cui i servizi online operano, impostando un precedente per l’intero settore. Mentre gli utenti si aspettano di poter comunicare in un ambiente sicuro e privato, è essenziale parallelamente che le piattaforme dimostrino che sono disposte a prendere misure concrete per prevenire l’abuso dei loro servizi. Con la crescente attenzione legale e pubblica, la sfida per i dirigenti delle piattaforme sarà quella di navigare in queste acque per vedere come possano implementare modelli di business sostenibili e responsabili.

Il futuro del DSA e delle normative che regolano le piattaforme online continuerà a suscitare discussioni vivaci. L’arresto di Durov offre spunti cruciali per riflettere sulle conseguenze di tali leggi e sulle responsabilità di chi gestisce i servizi digitali, ponendo le basi per un dialogo significativo sull’etica, la privacy e la legalità nel mondo della comunicazione online.

Privacy e Contenuti Illegali: Un Dilemma Etico

Nell’era digitale, il concetto di privacy è stato messo a dura prova. Da un lato, i cittadini aspirano a un diritto sacrosanto di privacy nelle loro comunicazioni; dall’altro, la società si trova a dover affrontare la dura realtà di abusi e crimine organizzato veicolati attraverso piattaforme di messaggistica. La situazione di Pavel Durov non fa altro che porre in evidenza questo delicato equilibrio tra libertà individuale e responsabilità sociale, trasformando il dibattito sulla privacy in una questione di urgente preoccupazione collettiva.

La protezione delle informazioni personali degli utenti è un principio fondamentale per qualsiasi piattaforma che pretenda di essere vista come una risorsa sicura e affidabile. Tuttavia, come dimostrano le recenti accuse contro Durov, la stessa protezione della privacy può essere sfruttata da chi ha intenti malevoli. Gli abusi che avvengono in un ambiente non sorvegliato pongono una domanda cruciale: fino a che punto i fornitori di servizi possono e devono garantire la privacy dei loro utenti senza compromettere la sicurezza pubblica?

Questa ambivalenza etica trova una sua espressione nei principi del Digital Services Act (DSA), che richiede alle piattaforme di operare con maggiore responsabilità riguardo ai contenuti illegali. La questione si complica ulteriormente quando si prende in considerazione la natura anonima e criptata delle comunicazioni su piattaforme come Telegram, dove l’assenza di controlli può dare origine a situazioni in cui i beni e i servizi illegali prosperano senza ostacoli. Solo negli ultimi anni, si è assistito a un aumento vertiginoso di contenuti violenti e osceni diffusi attraverso queste reti, posando un dilemma etico di non poco conto.

Davanti a questa crisi di fiducia, è fondamentale che i CEO delle piattaforme comprendano il rischio che comporta una mancanza di azione. È chiaro che il principio di “non sorveglianza” non deve essere interpretato come una scusa per non agire contro contenuti pericolosi. Ai dirigenti delle aziende spetta il compito di trovare un bilanciamento: progettare soluzioni tecnologiche capaci di monitorare l’attività potenzialmente illecita, senza però ledere i diritti alla riservatezza degli individui.

- Impegni legali: Le piattaforme devono collaborare attivamente con le autorità per garantire che i contenuti pericolosi vengano rimossi, mantenendo informazioni trasparenti riguardo alle azioni intraprese.

- Politiche di moderazione: È essenziale sviluppare politiche di moderazione più stringenti, capaci di contrastare le attività illegali senza compromettere l’anonimato e la privacy degli utenti

- Innovazione tecnologica: Investire in tecnologie di rilevazione che possano aiutare a identificare contenuti problematici in modo proattivo e tempestivo.

Le conseguenze di una gestione inadeguata di questo equilibrio sono evidenti: da un lato, la protezione della privacy potrebbe portare a un incremento dell’uso della piattaforma da parte di individui con intenzioni malevole; dall’altro, le misure di sicurezza inadeguate potrebbero esporre gli utenti a rischi reali. Le aziende devono quindi riflettere su quanto siano disposte a prendere posizione e investire in pratiche operative responsabili.

Non è solo la responsabilità giuridica che è in gioco; si tratta anche della reputazione e dell’integrità di una piattaforma. I consumatori di oggi sono sempre più consapevoli e informati; esigono non solo servizi che garantiscano la loro privacy, ma anche ambienti che tutelino la sicurezza e la legalità. Le attuali vicende legali legate alla figura di Durov e al suo operato con Telegram offrono una riflessione profonda su ciò che significa essere un leader nel settore tecnologico moderno, e quanto sia cruciale trovare soluzioni pragmatiche in un contesto così complesso. Il dilemma etico che ci troviamo a fronteggiare non è solo una sfida per i dirigenti, ma un appello collettivo a costruire un futuro in cui privacy e legalità possano coesistere in modo armonioso.

Reazioni del Settore alle Accuse

Le accuse rivolte a Pavel Durov hanno suscitato forti reazioni non solo tra i sostenitori della privacy, ma anche tra rappresentanti del settore tecnologico e delle comunicazioni. In un contesto dove la fiducia degli utenti nelle piattaforme digitali è già fragile, l’arresto di un leader come Durov solleva interrogativi profondi e preoccupazioni su come le aziende del settore possano rispondere a tali sfide.

Molti esperti e commentatori notano che la questione centrale è rappresentata dalla capacità delle piattaforme di bilanciare la privacy degli utenti con la necessità di combattere contenuti illegali. Diverse associazioni di categoria hanno preso posizione, esprimendo preoccupazione riguardo al potenziale impatto di questa situazione sull’innovazione e sulla libertà di espressione. Alcuni operatori del settore avvertono che un inasprimento delle normative potrebbe portare a una sorta di “caccia alle streghe” nei confronti delle piattaforme che potrebbero essere accusate di non fare abbastanza per moderare i contenuti.

Un sigillo di prova condiviso tra i leader del settore è la necessità di stabilire politiche di moderazione più efficaci, che possano rispondere alle preoccupazioni delle autorità senza compromettere la sicurezza e la privacy degli utenti. È innegabile che questo equilibrio sia difficile da raggiungere: da un lato, ci sono le pressioni per una maggiore responsabilità da parte delle piattaforme; dall’altro, la questione dell’autonomia e della libertà di comunicazione continua a essere un tema centrale di discussione.

La reazione di alcuni CEO di piattaforme concorrenti, come WhatsApp e Signal, è stata cauta ma ben definita. Molti hanno espresso solidarietà a Durov, sottolineando il valore della privacy e del diritto degli utenti di comunicare senza paura. Tuttavia, non hanno esitato a ribadire l’importanza della cooperazione con le autorità per garantire un ambiente online sicuro. Questa posizione evidenzia una tensione intrinseca: come possono le piattaforme mantenere la loro missione di proteggere la privacy degli utenti mentre collaborano per prevenire attività illecite?

All’interno della comunità tecnologica, si sta sviluppando un dibattito acceso su come le normative esistenti, inclusi gli obblighi imposti dal Digital Services Act, potrebbero essere migliorate. Alcuni esperti suggeriscono che è fondamentale esaminare il modo in cui le piattaforme possono implementare sistemi di monitoraggio non invasivi, capaci di rispettare la privacy degli utenti mentre si oppongono all’abuso. Ciò ha portato a proposte di sviluppo di tecnologie avanzate per l’analisi dei contenuti, che siano in grado di filtrare in modo tempestivo e responsabile i contenuti problematici.

Non tutti gli attori del settore, tuttavia, sono concordi. Ci sono posizioni radicalmente opposte che sostengono che l’arresto di Durov possa portare a un clima di paura tra i leader di piattaforme simili. L’idea che un CEO possa trovarsi a rispondere penalmente per il comportamento degli utenti potrebbe scoraggiare iniziative imprenditoriali e innovazioni, influenzando negativamente il progresso tecnologico e limitando la creazione di nuove soluzioni per i problemi che affliggono la gestione dei contenuti.

In questa fase instabile, il settore si ritrova a dover riflettere non solo sulle implicazioni legali e aziendali derivanti dalla situazione di Durov, ma anche sui valori fondamentali che le piattaforme digitali devono incarnare. La sostenibilità dell’attività commerciale è ora indissolubilmente legata alla loro responsabilità sociale. Gli utenti stanno diventando sempre più consapevoli della loro posizione e riguardo agli effetti delle loro scelte di comunicazione sulla società nel suo complesso. Questa evoluzione potrebbe guidare le piattaforme a prendere decisioni più lungimiranti e responsabili, ricercando un equilibrio tra privacy e legalità che risponda alle preoccupazioni di tutti gli attori coinvolti.

Prospettive Future per Telegram e le Piattaforme di Messaggistica

Il futuro di Telegram e delle piattaforme di messaggistica in generale è ora avvolto in un’atmosfera di incertezza e vigilanza. L’arresto di Pavel Durov ha suscitato interrogativi non solo sulle politiche interne di moderazione dei contenuti, ma anche sulla direzione che potrebbero prendere le normative e le pratiche aziendali nel settore delle comunicazioni digitali.

Con il cerchio mediatico focalizzato su Telegram, gli utenti si trovano a riflettere sulle loro scelte, mentre i dirigenti delle piattaforme devono affrontare una pressione crescente per garantire un ambiente digitale che sia sia sicuro che rispettoso della privacy. Le aziende stanno già discutendo nuove strategie, cercando di bilanciare le libertà degli utenti con la necessità di operare in linea con le leggi nazionali e internazionali. Ciò significa che molte piattaforme potrebbero cominciare a rivedere le loro politiche di moderazione per rispondere alle crescenti aspettative e alle preoccupazioni legate al contenuto illegale.

Un aspetto inoltre cruciale delle discussioni future riguarda la questione del design delle piattaforme stesse e delle funzionalità offerte. Ciò potrebbe sfociare in un aumento delle tecnologie di monitoraggio intelligente che aiutano a prevenire abusi senza ledere il diritto alla privacy. È probabile che emergano soluzioni innovative, come algoritmi in grado di individuare comportamenti sospetti in modo tempestivo, offrendo al contempo agli utenti la garanzia della riservatezza delle loro comunicazioni.

La questione legislativa è un altro tema spinato che si svilupperà nei prossimi anni. Con il DSA che già stabilisce obblighi per le piattaforme digitali, ci si aspetta che i governi e le autorità di regolamentazione interpreti le normative in modo tale da adattarsi a un contesto in continua evoluzione. La necessità di un dialogo attivo e costruttivo tra le aziende, le autorità e la società civile sarà essenziale per garantire che i diritti e la sicurezza degli utenti siano tutelati simultaneamente.

Inoltre, ci si attende che l’arresto di Durov apra nuove porte a dibattiti importanti riguardo all’etica nel business tecnologico. La responsabilità sociale delle piattaforme non può più essere ignorata, e le aziende che risponderanno positivamente a queste richieste potrebbero guadagnare la fiducia di una base utenti sempre più consapevole e critica. La sostenibilità delle aziende tecnologiche si trova ora a un bivio significativo: investire in politiche che stimolino la sicurezza e la cooperazione, oppure rischiare di trovarsi intrappolate in controversie legali simili a quelle che sta affrontando Telegram.

- Incertezza normativa: Le aziende devono prepararsi a navigare in un contesto normativo non solo europeo, ma anche globale, in continua evoluzione.

- Innovazione responsabile: La spinta verso soluzioni tecnologiche avanzate sarà fondamentale per affrontare la questione dei contenuti illegali, garantendo al contempo la privacy degli utenti.

- Dialogo proattivo: È cruciale instaurare un dialogo costruttivo con le autorità e i gruppi di interesse per affrontare questioni etiche e legali.

Il futuro delle piattaforme di messaggistica come Telegram sarà quindi probabilmente caratterizzato da una maggiore attenzione alla responsabilità e all’etica, mentre i dirigenti del settore si confronteranno continuamente con il delicato equilibrio tra libertà e sicurezza. È un momento di riflessione e cambiamento, dove ogni passo verso una gestione più responsabile della comunicazione digitale può rappresentare un’opportunità per favorire la fiducia e la sicurezza degli utenti in un panorama virtuale in rapida evoluzione.