Questa non è una persona ma è una minaccia prodotta dai GAN

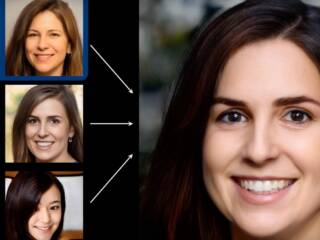

Dai un’occhiata alla persona in cima a questo articolo. Sembra amichevole – forse è qualcuno con cui ti connetteresti su Linkedin o assumeresti per gestire i tuoi social media.

Se la vedessi alla lezione di ginnastica di tuo figlio, saluteresti e farai qualche chiacchierone imbarazzante. A seconda della tua persuasione, puoi anche scorrere a destra sul suo profilo di Tinder se ti viene data la possibilità.

C’è solo un problema: non esiste.

L’immagine sopra è stata generata utilizzando una nuova tecnica di Machine Learning chiamata Generative Adversarial Networks (GAN).

Inventato nel 2014, la tecnica è esplosa in popolarità e possibilità. Il vincitore del premio Turing Yann LeCun l’ha descritta come “l’idea più interessante dell’apprendimento automatico negli ultimi 20 anni”.

È usato nei videogiochi, nell’astronomia e nell’arte. E sta conquistando i media e il mondo legale.

GAN sotto il cofano

I GAN funzionano prendendo due reti neurali Deep Learning e mettendole l’una contro l’altra in un mini battle-royale.

La prima rete è la rete generativa. Di solito è una rete neurale convoluzionale ed è addestrata su una serie di immagini di esempio.

Come tutte le CNN, apprende gli attributi e i modelli del set di addestramento ed è in grado di iniziare a produrre immagini simili da zero.

La seconda rete è la rete discriminante.

È anche addestrato sui dati originali ed è progettato per valutare se un’immagine specifica segue o meno la distribuzione statistica del set di dati originale. In parole povere, quando viene data una nuova immagine, cerca di indovinare se l’immagine appartiene al set di immagini originale o non appartiene.

Questo è dove le cose si fanno interessanti. Piuttosto che lasciare che le reti ronzano in silenzio da sole, i GAN le mettono l’una contro l’altra. L’obiettivo della rete generativa è creare immagini false abbastanza buone da ingannare la rete discriminante.

E l’obiettivo della rete discriminante è quello di evitare di essere ingannati, di indovinare con precisione quali immagini sono false e quali appartengono realmente ai dati originali.

Più e più volte, la rete generativa creerà una nuova immagine e la rete discriminante la valuterà. Controlleranno quindi il loro lavoro per vedere chi ha vinto ogni round. Mentre si quadrano l’uno contro l’altro per migliaia e migliaia di round, entrambe le reti usano la backpropagation per imparare dai loro errori e successi.

La rete generativa migliora nel creare falsi realistici e la rete discriminante migliora nel individuarli. Nel tempo, entrambe le reti migliorano competendo tra loro. La tecnica si basa sui recenti progressi nel calcolo parallelo per addestrare rapidamente le reti: NVIDIA e altre società di GPU sono i primi ad adottare.

Alla fine della routine di allenamento, la rete generativa è diventata molto brava a creare immagini false realistiche. Funzionando da solo – dopo tutti gli utili miglioramenti delle sue frenetiche reti discriminatorie – è ora in grado di generare falsi che spesso sono abbastanza buoni da ingannare un essere umano.

È un po ‘come un giocatore di baseball che fa oscillare una mazza ponderata prima di salire sul piatto, o uno studente universitario che studia usando domande più difficili di quanto si aspettino di sostenere un esame.

Allenandosi con un astuto avversario che migliora con ogni prova, la rete generativa migliora costantemente il suo gioco. Quando l’avversario duro viene rimosso, e ha il compito di ingannare un essere umano run-of-the-mill, il compito è relativamente facile.

GAN causano problemi

Non sorprende che i sistemi di intelligenza artificiale in grado di creare falsi umani convincenti stiano suscitando grande scalpore e ben oltre il mondo del Deep Learning.

Nei media, i GAN rappresentano una grave minaccia alla credibilità. Si legano naturalmente a Deep Fakes – in cui una rete neurale impersona una persona reale, creando video o immagini in cui sembrano fare o dicendo qualcosa che in realtà non hanno mai fatto o detto.

Certo, le persone sono sempre state in grado di creare una celebrità o un politico di Photoshop in un evento a cui non hanno mai partecipato, o mostrare loro di stringere la mano a qualcuno che non hanno mai incontrato.

Ma creare un vero video in cui sembrano fare un’osservazione razzista o dire qualcosa che infiammerebbe il loro partito – è una capacità molto più difficile e una che è spesso aiutata dai GAN.

È una minaccia esistenziale per i media, dove la credibilità dei contenuti (a parte le notizie false) è assolutamente fondamentale. Come puoi sapere se una videocamera nascosta da un informatore è reale o un elaborato falso creato da un GAN e destinato a sabotare la reputazione di un avversario?

E ci sono anche problemi più oscuri, più spinosi.

La pornografia abilitata per GAN è già apparsa su Internet , spesso costruita usando i volti di celebrità reali.

È probabile che il problema si diffonda. Le celebrità sono un segno facile, poiché ci sono già molte foto disponibili su Internet e l’interesse pubblico per la loro vita personale è già elevato. Ciò rende relativamente facile trovare i dati di allenamento per un GAN e anche molto redditizio per pubblicare un video o una foto falsi.

Ma man mano che le tecnologie migliorano e le dimensioni richieste degli insiemi di formazione si riducono, gli hacker potrebbero potenzialmente creare false clip con classificazione X di quasi chiunque, utilizzandole negli schemi di estorsione o ricatto.

Chi possiede persone false?

Al di là di queste minacce esistenziali e rischi inquietanti, anche i GAN creati per motivi positivi sollevano alcune questioni legali difficili. Una domanda centrale è chi detiene effettivamente i diritti sulle immagini create da un GAN.

La legge sul copyright degli Stati Uniti è abbastanza chiara che un’opera protetta da copyright deve avere un autore umano. Le sfide a questa premessa di base sono fallite in modi diversi e spesso sensazionali, dai casi sulla proprietà dei filmati di sorveglianza creati da una telecamera automatizzata al famigerato caso Monkey Selfie , in cui PETA ha cercato di affermare che un macaco crestato possedeva i diritti sulle foto scattate sulla fotocamera di un fotografo naturalista.

Se un’opera ha bisogno di un autore umano per ricevere protezione del copyright, qualcuno possiede i diritti sulle immagini prodotte da un GAN?

Dopotutto, non sono presi da un essere umano che brandisce una macchina fotografica, ma piuttosto dal risultato finale di due programmi per computer in lotta. È una domanda difficile, ma per fortuna ci sono precedenti da altri campi, che tratterò di seguito.

E andando oltre la proprietà, ci sono limiti su cosa si può fare con un GAN? Puoi usarlo per impersonare chiunque desideri?

Gli umani reagiscono

Di fronte alla minaccia dei GAN, molte organizzazioni e legislatori stanno già combattendo. La Screen Actors ‘Guild (SAG) – che rappresenta gli interessi di attori e animatori – sta attivamente facendo pressioni per la regolamentazione che impedisce alle società di produzione di sostituire gli attori viventi con ologrammi abilitati ai GAN.

Questo ha molto senso: se riesci a creare un Brad Pitt falso e fotorealistico e fargli fare le tue offerte, perché preoccuparsi di assumere il vero attore? La versione immaginata dai GAN non ha bisogno di interruzioni, non dimenticherà le sue linee ed è improbabile che richieda uno stipendio a sette cifre. Quando si tratta di attori che sono morti, le cose diventano più complesse. SAG vorrebbe bloccare i diritti per creare una celebrità sintetica per sempre, ma ciò si scontra con problemi sfidanti del Primo Emendamento.

Anche diversi stati si stanno già unendo alla mischia. Il 3 ottobre 2019, la California ha approvato l’AB-602, che vieta l’uso dei GAN per creare falsa pornografia o produrre falsi filmati di politici entro 60 giorni dalle elezioni. New York sta prendendo in considerazione una legislazione che si avvicini ai GAN attraverso il diritto alla pubblicità.

GAN per sempre

È assolutamente necessaria una certa regolamentazione per i GAN. Certamente, nell’esempio della pornografia sintetica o di altri contenuti di sfruttamento, ha senso che i legislatori intervengano e eliminino i cattivi attori

Tuttavia, ci sono rischi anche con GAN che regolano eccessivamente. Se utilizzate per il bene, le reti contraddittorie generative possono essere una tecnologia incredibilmente potente con il potenziale per molti vantaggi potenti.

Prendi, ad esempio, il motivo per cui i GAN sono stati originariamente creati. La tecnologia è stata originariamente sviluppata non per produrre falsi convincenti a scopo illustrativo, ma piuttosto per generare grandi set di dati per l’addestramento di altri sistemi di Deep Learning.

In Machine Learning in generale, trovare buoni dati è difficile. Soprattutto con nuove reti e tecniche, i data scientist hanno bisogno di molte immagini per addestrare un nuovo sistema di intelligenza artificiale visiva, a volte un milione di immagini o più. L’acquisto di tutte quelle immagini è proibitivo, soprattutto per singoli scienziati o gruppi di ricerca.

I GAN sono stati creati per risolvere questo problema. Con un GAN, uno scienziato che sta creando, ad esempio, un nuovo sistema di riconoscimento facciale non avrebbe bisogno di uscire e acquistare milioni di immagini di volti umani.

Piuttosto, potevano addestrare un GAN una volta, quindi utilizzarlo per generare tutte le immagini di volti falsi di cui avevano bisogno e addestrare il loro nuovo sistema su questi.

I GAN vengono ancora utilizzati principalmente per questo scopo. Non è una soluzione perfetta – un collega di IBM ha descritto questo processo come simile a fotocopiare una fotocopia piuttosto che fotocopiare un documento originale, con gli stessi tipi di distorsioni e perdite di qualità – ma è ancora uno strumento importante nella cintura di uno scienziato di dati.

I GAN sono anche cruciali laddove sono disponibili dati limitati sulla formazione reale. Sono stati proposti, ad esempio, come una soluzione parziale alla mancanza di immagini di addestramento che raffigurano i volti di persone oltre i maschi caucasici, e quindi come un modo per aumentare la diversità dei sistemi di Deep Learning.

Puoi sperimentare con le tue persone false su ThisPersonDoesNotExist.com

Oltre all’apprendimento automatico, i GAN hanno un’ampia varietà di applicazioni del mondo reale. In fotografia e moda, possono creare ritratti credibili senza la necessità di assumere modelli o affittare una location.

Questo rende molto più facile per un fotografo o un designer – in particolare qualcuno che ha appena iniziato – realizzare un concetto o mostrare un nuovo capo di abbigliamento senza un investimento iniziale elevato.

In altri campi, i GAN vengono utilizzati ovunque sia presente un modello visivo. Possono modellare la materia oscura in astronomia, creare modelli 3D di oggetti fisici da una fotografia 2D, creare stanze e spazi falsi per i videogiochi, mostrare come è probabile che una persona invecchi e persino generare idee per nuove molecole o proteine nella ricerca sul cancro.

GAN Andando avanti

In futuro, i GAN diventeranno ancora più potenti. Al momento, nella sfera visiva, sono per lo più limitati a produrre immagini relativamente limitate e altamente strutturate in cui sono disponibili molti dati di allenamento. I volti sono un esempio perfetto: variano tra le persone ma hanno molti degli stessi attributi di base.

E con oltre 6 miliardi di persone reali nel mondo, ci sono molte facce là fuori da cui un GAN può imparare (di nuovo, supponendo che il suo creatore abbia risorse sufficienti per acquistare grandi set di dati).

Con il miglioramento delle tecnologie, tuttavia, queste barriere diventeranno meno importanti. È opinione diffusa che nei prossimi 3-5 anni i GAN avanzeranno al punto da poter creare scene completamente nuove da zero, non solo primi piani di volti.

Un designer potrebbe dire, ad esempio, “Vorrei uno scatto di una donna che scendeva le scale, teneva la ringhiera e guardava su e sopra la sua spalla”, e un GAN poteva creare quella scena esatta con dettagli fotorealistici.

Esistono scorci allettanti in questo futuro. Una rete chiamata Stack GAN può già fare questo per singoli oggetti , generando un’immagine di un falso uccello basato su una descrizione testuale del suo aspetto.

E un altro GAN può già generare una scena di strada decente – se non perfetta – utilizzando una mappa bloccata di auto, persone, ecc.

Chiaramente, mentre queste tecnologie avanzano, potrebbero sostituire enormi parti della fotografia, del cinema, dell’interior design o di qualsiasi altro campo che si affida ai media visivi.

Qualcuno in questi settori dovrebbe immediatamente cercare un nuovo lavoro o rischiare di essere sostituito da un GAN? Tutte le arti visive saranno sostituite da macchine?

Ritorno al futuro

Prima di entrare in modalità di fuoriuscita totale, è importante fare una pausa per un momento e ricordare che esiste già un campo con molti degli stessi attributi e prodotti finali dei GAN.

In questo campo, qualcuno si tuffa nella memoria di milioni di persone, luoghi o oggetti che hanno visto. Attingono da una formazione approfondita, a volte da critici aspri o astuti. In alcuni casi, contengono anche descrizioni testuali di una scena o di un concetto desiderati.

Quindi raccolgono alcuni strumenti e li usano per creare un’immagine totalmente nuova. L’immagine può mostrare una persona conosciuta in una nuova circostanza, oppure può mostrare una persona immaginata in una scena che in realtà non esiste . Quel campo si chiama “illustrazione”.

Illustratori, animatori e artisti CGI fanno abitualmente le stesse cose di un GAN: è il loro intero lavoro immaginare nuovi scenari, persone e luoghi e dar loro vita sulla pagina o sullo schermo. In molti casi, le loro creazioni sono fotorealistiche, specialmente oggi, quando le creazioni CGI sono spesso indistinguibili da luoghi reali o attori reali.

Visto come uno strumento di illustrazione piuttosto che una minaccia totalmente nuova, i GAN sono molto meno spaventosi.

Certo, rendono la creazione di illustrazioni realistiche molto più semplice e (a seconda dell’abilità dell’illustratore o dell’animatore), più realistica. Ma alla fine, non stanno facendo nulla di nuovo; stanno solo applicando Deep Learning a un vecchio concetto artistico – uno che risale al primo umano che ha dipinto un bufalo su una parete della caverna.

La visualizzazione dei GAN come strumento di illustrazione risolve anche molte delle questioni legali relative alle reti. I tribunali hanno costantemente stabilito che le opere create da CGI sono ammissibili alla protezione del copyright perché sono prodotte attraverso le scelte creative di un operatore umano.

Inoltre, gli strumenti CGI non sono sempre deterministici: prendendo le indicazioni da un essere umano, “riempiono” sistematicamente le azioni tra i fotogrammi chiave, o altrimenti creano nuove sequenze non modellate direttamente dal progettista.

Nessuno sosterrebbe che un animatore dovrebbe perdere la protezione del copyright per il suo film perché After Effects ha completato parte dell’azione tra i fotogrammi chiave o ha aggiunto trame e illuminazione ai suoi wireframe. Sono le sue scelte creative – e il modo in cui portano al prodotto finale – che contano.

I GAN esistono in uno spazio simile. Possono immaginare nuove scene, ma per generare un output utile, hanno ancora bisogno della direzione degli umani su cosa creare. Anche quando un GAN sta generando casualmente volti, ci vogliono comunque input e direzioni di un umano per decidere quali sono credibili, che si adattano a un particolare progetto creativo, ecc.

Fornire questa direzione è un esercizio creativo stesso, e quindi uno che dovrebbe consentire i diritti d’autore . E i risultati dei GAN non sono perfetti – in molti casi hanno ancora bisogno dell’aiuto umano per ottenere risultati utilizzabili.

Prendi, ad esempio, la foto nella parte superiore di questo articolo. La donna sembra realistica a prima vista, ma guarda più da vicino.

Che succede con il suo orecchio? È un orecchino? Qualche schmutz? L’immagine di base sembra piuttosto buona, ma trae vantaggio dalla pulizia e dalle modifiche di questo operatore umano (leggermente) esperto. Tutte queste modifiche e scelte sono atti creativi che trasformano l’output grezzo del GAN in un’illustrazione utilizzabile e convincente.

Dove andremo?

Le reti di contraddittori generativi presentano alcuni importanti problemi che la società dovrebbe continuare a contemplare ed esplorare. Gli usi sfruttatori delle tecnologie – per falsi profondi e contenuti espliciti – sono preoccupanti, ed è esattamente il tipo di cosa che i regolatori dovrebbero affrontare prima piuttosto che dopo.

Allo stesso tempo, tuttavia, la società dovrebbe essere cauta nel prendere troppo pesantemente la mano nel regolare queste nuove tecnologie, e quindi soffocare le loro applicazioni positive.

Sebbene l’output di GAN possa essere spaventoso – o anche solo molto inquietante – ha anche il potenziale di rivoluzionare molte delle arti visive, rendere la moda e la fotografia più inclusive, contribuire alla scoperta di droghe e risolvere ogni tipo di problema ancora inimmaginabile.

L’attuale campo illustrativo fornisce un quadro giuridico ed etico per iniziare a confrontarsi con domande sui GAN e il loro impatto.

Le persone false possono essere spaventose, ma sono qui per restare. Come società, dobbiamo riconoscere le loro minacce, ma anche abbracciarne i benefici.

Da qualche parte nei loro volti sorridenti – e nei GAN dietro di loro – c’è l’opportunità di realizzare benefici duraturi per le persone reali che li hanno immaginati come realtà.

DIRETTORE EDITORIALE

Michele Ficara Manganelli ✿

PUBBLICITA’ – COMUNICATI STAMPA – PROVE PRODOTTI

Per acquistare pubblicità CLICCA QUI

Per inviarci comunicati stampa e per proporci prodotti da testare prodotti CLICCA QUI