L’allerta degli scienziati sull’influenza dell’AI sulle nostre decisioni quotidiane

Indice dei Contenuti:

Le scelte in mano all’AI: un avvertimento degli esperti

Recentemente, esperti dell’Università di Cambridge hanno lanciato un allarme riguardo ai potenziali sviluppi dell’Intelligenza Artificiale, sottolineando come le tecnologie emergenti possano giungere a influenzare profondamente le nostre decisioni quotidiane. La capacità dei modelli di linguaggio avanzati, come quelli sviluppati da aziende come Nvidia, di analizzare e interpretare le intenzioni umane, sta creando una nuova forma di interazione tra gli utenti e le piattaforme digitali. Queste tecnologie non si limitano a rispondere a domande, ma sono in grado di ‘leggere’ il contesto, adattando le informazioni presentate a ciò che gli utenti desiderano o necessitano in un dato momento.

La preoccupazione centrale in questo dibattito è la capacità di tali sistemi di diventare strumenti di manipolazione, influenzando le scelte degli individui, dai semplici acquisti fino alle decisioni di voto. Jonnie Penn, uno dei ricercatori coinvolti nello studio, avverte che senza una regolamentazione adeguata, l’ecosistema delle tech companies potrebbe trasformare le intenzioni umane in una sorta di merce, fungendo da moneta di scambio nel mercato della pubblicità e della personalizzazione. Questo cambierebbe radicalmente le dinamiche di interazione tra consumatori e aziende, con potenziali implicazioni etiche e sociali pertanto cruciali da esaminare.

Il messaggio trasmesso dall’equipe di Cambridge è chiaro: è essenziale comprendere le implicazioni dell’Intelligenza Artificiale sulle nostre scelte e sulla nostra autonomia decisionale, prima che tali tecnologie consolidino una posizione di controllo che potrebbe rivelarsi pericolosa per l’individuo e la società nel suo complesso.

L’economia dell’attenzione e delle intenzioni

Il concetto di **economia dell’attenzione** ha preso piede nell’era digitale, definendo un paradigma in cui la capacità di catturare e mantenere l’attenzione degli utenti è diventata una risorsa preziosa. Le piattaforme online, in particolare i **social network**, sono progettate per massimizzare il tempo trascorso dagli utenti, favorendo la creazione di un ciclo continuo di sfruttamento delle abitudini e delle preferenze individuali. Questo approccio non è solo un modo per aumentare i profitti, ma si traduce in pratiche che trasformano l’attenzione umana in un asset monetizzabile, con grossi guadagni per le aziende coinvolte.

L’emergere dell’**economia delle intenzioni** è un passaggio logico che si distacca dalla mera economia dell’attenzione. Questa nuova dimensione si fonda su modelli di intelligenza artificiale capaci di anticipare e comprendere le intenzioni degli utenti. Le organizzazioni possono raccogliere e analizzare dati relazionati ai comportamenti, ai contesti e alle motivazioni per determinare quale contenuto esporre agli utenti. Secondo Jonnie Penn, uno degli autori del recente studio, ciò che si profila è un mercato dove le intenzioni delle persone potrebbero diventare una forma di valuta, da scambiare con aziende a caccia di profitti. La capacità di prevedere e influenzare le scelte si trasforma allora in uno strumento di potere.

Questa situazione solleva interrogativi cruciali sulla **privacy** e sull’**etica** delle pratiche previste. Un’intelligenza artificiale che comprende e dirige le decisioni degli utenti non fa altro che porre in discussione la genuinità delle scelte effettuate. Temere un’eccessiva dipendenza da queste tecnologie è legittimo, dato che il potenziale per un uso improprio è reale e potrebbe portare a forme di manipolazione subdole, rendendo necessaria una riflessione profonda e una gestione adeguata di tali strumenti.

Rischi per la democrazia e le aspirazioni umane

Il panorama attuale solleva preoccupazioni importanti su come l’Intelligenza Artificiale possa intaccare i principi fondamentali della democrazia e delle aspirazioni individuali. Le ricerche condotte dagli scienziati di Cambridge evidenziano come la personalizzazione estrema dei contenuti, alimentata da modelli di IA, rischi di alterare non solo il modo in cui le informazioni vengono ricevute, ma anche le scelte collettive di una società. Quando le piattaforme digitali iniziano a modellare le percezioni del pubblico e a influenzare le decisioni elettorali, ci si trova di fronte a un potenziale assalto alla neutralità e alla diversità della sfera pubblica.

Un fenomeno allarmante è la creazione di “echo chambers” in cui gli utenti sono esposti a opinioni e news che confermano le loro convinzioni preesistenti. Tale dinamica non solo limita la pluralità di voci, ma sembra anche compromettere la capacità delle persone di confrontarsi con argomenti alternativi o dissenzienti. Questo non solo è dannoso per i dibattiti democratici, ma costituisce anche una minaccia per una società in cui il diritto di scelta è fondamentale. La compagnia di tecnologie che nascondono le loro pratiche di profilazione e pubblicità è una questione di crescente preoccupazione; può indirizzare il consenso pubblico secondo criteri economici, piuttosto che etici.

Gli effetti che questa manipolazione sottile e sofisticata dell’intenzione umana potrebbe avere sul funzionamento delle democrazie meritano attenzione. Le tensioni tra interesse commerciale e responsabilità sociale devono spingere a un dialogo aperto riguardo a cosa significhi, in un contesto democratico, “decidere liberamente”. La trasparenza e l’equità nella raccolta e nell’utilizzo dei dati personali devono diventare prioritari, se si vogliono evitare le distorsioni al funzionamento stesso delle istituzioni democratiche e delle aspirazioni umane più elevate.

Un futuro di manipolazione e monetizzazione

Con l’avanzare delle tecnologie intelligenti, il futuro si delinea come un territorio di opportunità ma anche di potenziali rischi. I modelli di linguaggio avanzati, come quelli emersi recentemente, possiedono la capacità di anticipare e influenzare le decisioni degli utenti, frapporsi nelle dinamiche quotidiane e offrire interazioni sempre più personalizzate. Immaginate un’intelligenza artificiale che riesce a intuire istantaneamente le vostre necessità: “Hai detto di sentirti stanco, vuoi che ti suggerisca un ristorante vicino con buone recensioni?” Questa non è fantascienza, ma una realtà che sta emergendo grazie a nuovi algoritmi che raccolgono dati intenzionali, comportamentali e psicologici.

In questo contesto, le grandi aziende tecnologiche potrebbero intravedere opportunità lucrative nell’alimentare un mercato emergente incentrato sulla monetizzazione delle intenzioni. Le informazioni sui desideri degli utenti potrebbero essere vendute agli inserzionisti, permettendo a queste aziende di profilare e targetizzare notizie economiche con una precisione senza precedenti. Le implicazioni di questa cornice non riguardano solo la sfera commerciale; potrebbero portare a decisioni strategiche pianificate più a tavolino che orientate realmente al bene degli utenti.

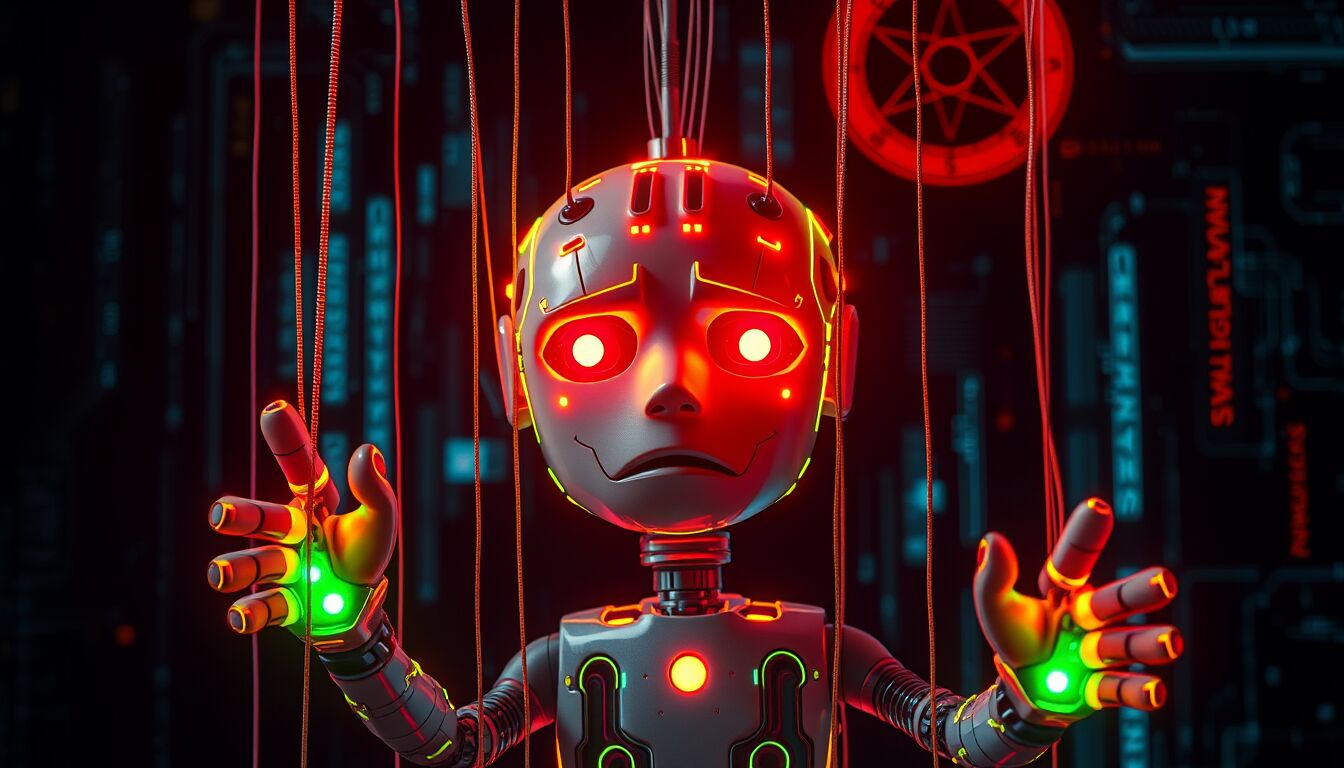

Questa prospettiva suscita interrogativi inquietanti sulla libertà di scelta. Con dati personali trattati come merce, la questione di quanto ciascuno di noi sia in realtà “libero” di decidere diventa centrale. Questa manipolazione ragionata delle scelte quotidiane potrebbe condurre a un consumo passivo di idee e opportunità, dove l’utente diventa, di fatto, un marionetta nelle mani di algoritmi mirati. Pertanto, non solo l’individuo, ma l’intera struttura delle interazioni commerciali e sociali è chiamata a confrontarsi con questa sfida radicale: la capacità di differenziare tra ciò che si desidera realmente e ciò che viene suggerito come desiderabile da un’intelligenza artificiale.

La necessità di regolamentazione e etica nell’AI

In uno scenario in cui l’Intelligenza Artificiale svolge un ruolo sempre più preponderante nelle nostre vite, la regolamentazione e l’etica emergono come strumenti fondamentali per garantire un uso responsabile e sostenibile di tali tecnologie. Gli scienziati dell’Università di Cambridge mettono in evidenza l’urgenza di stabilire normative chiare che possano governare la raccolta e l’utilizzo delle informazioni sugli utenti. Senza meccanismi di controllo adeguati, le conseguenze per la società potrebbero rivelarsi devastanti, trasformando le intenzioni umane in meri strumenti di lucro per le aziende tech.

Emerge una chiara necessità di sviluppare un’infrastruttura legislativa che tuteli la privacy degli utenti. La raccolta di dati per fini commerciali deve necessariamente bilanciarsi con la protezione dei diritti individuali. Regole ben definite possono prevenire abusi e garantire che i consumatori siano informati e consapevoli riguardo a come le loro informazioni vengono utilizzate. È imperativo che i legislatori collaborino con esperti nel campo dell’AI per creare linee guida che impediscano comportamenti manipolativi o abusivi da parte delle aziende.

Parallelamente, è necessario un dibattito etico sull’evoluzione dell’AI e sul suo impatto delle scelte umane. Le aziende devono assumersi responsabilità sociali, implementando pratiche di trasparenza nella loro operatività. Organizzare tavole rotonde con esperti di vari settori, oltre a rappresentanti della società civile, è essenziale per cercare un consenso sulla direzione da prendere. L’obiettivo è stabilire un framework etico che indirizzi lo sviluppo tecnologico verso un futuro in cui la tecnologia supporta, piuttosto che limita, la libertà di scelta, garantendo che ciascun individuo possa orientarsi liberamente nel complesso panorama comunicativo contemporaneo.