La startup IdentifAI e la sua missione

IdentifAI e la missione di proteggere dalla disinformazione

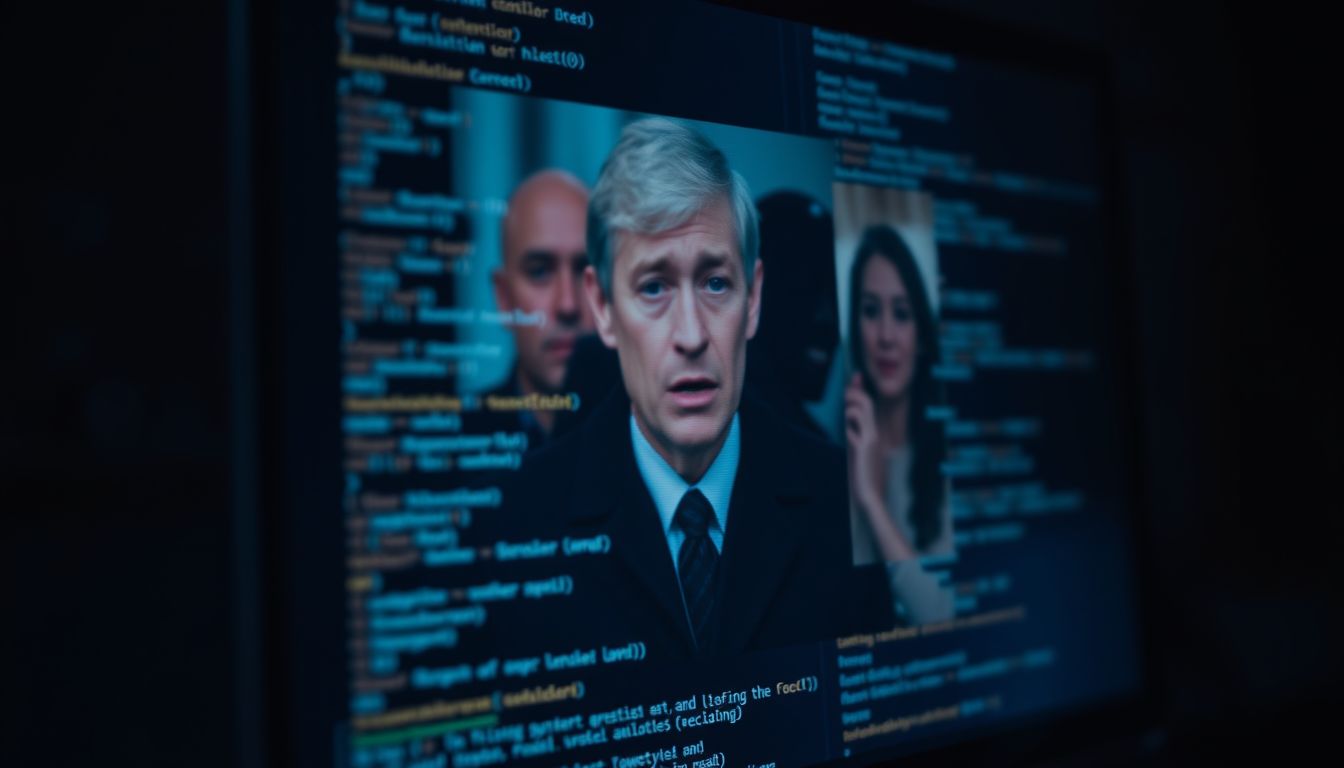

IdentifAI, una startup innovativa fondata da Marco Ramilli e Marco Castaldo, si propone di fornire strumenti avanzati per il riconoscimento dei contenuti generati dall’intelligenza artificiale, in contrapposizione a quelli prodotti dall’uomo. Questa iniziativa è stata concepita per servire sia i cittadini che i responsabili delle aziende e degli enti pubblici, con l’obiettivo dichiarato di affrontare e contenere una delle sfide più insidiose della nostra epoca: la diffusione dei deepfake. La startup intende, infatti, creare un ambiente informativo più trasparente e affidabile, contrastando l’impatto negativo che questi strumenti digitali possono avere a livello sociale, politico ed economico.

Il riconoscimento del problema è fondamentale: i deepfake, tecnologie che permettono di sovrapporre volti e voci a contenuti esistenti creando falsi plausibili, possono condurre a situazioni di discredito e manipolazione. Marco Ramilli sottolinea che l’evoluzione della tecnologia in ambito di intelligenza generativa porterà a un progressivo avvicinamento dei mondi fisico e digitale, resi indistinguibili all’occhio umano. Con il recente investimento di 2,2 milioni di euro, guidato da United Ventures, IdentifAI si appresta ad ampliare le proprie capacità, sviluppando modelli generativi capaci di distinguere contenuti creati artificialmente da quelli autentici.

La startup non è sola nella sua missione; il gruppo di investitori, tra cui nomi rilevanti come Edoardo Alessandri di Wellness Holding e Matteo Fago di Venere.com, rappresenta un supporto significativo per il progresso delle tecnologie dedicate alla lotta contro i deepfake. IdentifAI si propone quindi non solo di combattere la disinformazione, ma di responsabilizzare i cittadini e le istituzioni nel riconoscere e rispondere a queste sfide digitali.

Il rischio dei deepfake nel contesto attuale

I deepfake rappresentano una minaccia crescente in un contesto globale dove la disinformazione può avere effetti devastanti. La capacità di manipolare video e audio in modo tanto sofisticato da ingannare l’occhio umano ha portato a una serie di incidenti inquietanti, che hanno coinvolto sia individui pubblici che aziende. Un caso emblematico risale al 2020, quando il volto di Giorgia Meloni fu sovrapposto a quello di attrici nel settore del porno, un esempio che dimostra quanto possa essere insidiosa e distruttiva questa tecnologia. In un altro episodio, avvenuto nel febbraio 2024, un’azienda di Hong Kong subì una truffa di ben 25 milioni di euro: i truffatori, utilizzando un deepfake, riuscirono a simulare la figura di un direttore finanziario durante una videoconferenza, inducendo i collaboratori a effettuare bonifici come richiesto.

Questi eventi non sono isolati, ma piuttosto indicativi di un fenomeno che sta guadagnando terreno. È evidente che i deepfake non solo possono distorcere la verità, ma possono anche ingenerare confusione e diffidenza nelle fonti di informazione. Proprio per questa ragione, esiste un crescente allarme tra i leader di settore e le istituzioni pubbliche riguardo alla potenziale destabilizzazione che queste tecnologie possono provocare. Le conseguenze economiche e politiche possono rivelarsi devastanti, influenzando l’opinione pubblica, danneggiando la reputazione di figure pubbliche e generando un clima di sfiducia nelle interazioni online.

Inoltre, il campo di applicazione dei deepfake è ampio, toccando aspetti del marketing e della comunicazione creativa, ma purtroppo è utilizzato anche in contesti nefasti, come le frodi finanziarie e la manipolazione dell’informazione. Questo rende fondamentale l’implementazione di soluzioni robuste e strategiche per contrastare un fenomeno che si evolve rapidamente. In questo scenario reso pericoloso dai deepfake, strumenti come quelli sviluppati da IdentifAI si rivelano essenziali per monitorare, riconoscere e difendersi da rancide pratiche di disinformazione.

Le soluzioni offerte da IdentifAI

IdentifAI e le soluzioni innovative per combattere i deepfake

IdentifAI si propone di affrontare la crescente minaccia dei deepfake attraverso lo sviluppo di strumenti avanzati capaci di riconoscere e differenziare contenuti autentici da quelli generati artificialmente. La startup sta progressivamente implementando soluzioni che forniscono ai cittadini e alle istituzioni la possibilità di verificare l’autenticità dei contenuti che fruiscono quotidianamente. I modelli progettati da IdentifAI si basano su algoritmi sofisticati di intelligenza artificiale, definiti come “modelli degenerativi”. Questi modelli hanno il compito di analizzare e scomporre i contenuti generati da IA, producendo sintetizzazioni e confermando la loro origine, se artificiale o umana.

Marco Ramilli, fondatore dell’azienda, evidenzia l’importanza di queste tecnologie: “Se gli individui non sono in grado di distinguere tra realtà e finzione, abbiamo bisogno di strumenti che possano fare questa distinzione per noi”. IdentifAI non si limita a fornire un’unica soluzione, ma si adopera per creare un ecosistema di strumenti di verifica che variano dalle applicazioni per individui fino a sistemi integrati per le grandi organizzazioni. Inoltre, il team di IdentifAI è impegnato nel continuo aggiornamento e affinamento dei propri modelli, così da adattarsi ai rapidissimi cambiamenti nel campo dell’intelligenza artificiale generativa.

Un altro aspetto cruciale del lavoro di IdentifAI è la sensibilizzazione e l’educazione degli utenti finali. La startup non solo sviluppa strumenti, ma si impegna anche a formare i cittadini sulle modalità di riconoscimento della disinformazione, fornendo risorse che aiutano a capire il funzionamento delle tecnologie IA. Queste iniziative sono fondamentali per costruire una cultura di consapevolezza e responsabilità nell’uso delle informazioni online, promuovendo un utilizzo etico e informato delle tecnologie digitali.

Il potenziale di mercato per il rilevamento dei deepfake è significativo, con previsioni che parlano di una crescita da 600 milioni di dollari a 3,9 miliardi di dollari entro il 2029. Questo scenario offre a IdentifAI l’opportunità di espandere ulteriormente le proprie capacità e di posizionarsi come leader nel settore della sicurezza digitale e della protezione da contenuti manipolati.

I limiti e le sfide dei deepfake

La generazione di deepfake, sebbene in grado di realizzare contenuti apparentemente verosimili e convincenti, presenta dei limiti tecnici intrinseci. Marco Ramilli, fondatore di IdentifAI, spiega come la qualità dei dati alimenti le intelligenze artificiali deputate alla creazione di questi contenuti. Senza una quantità adeguata di dati, come ad esempio campioni vocali o immagini specifiche di una persona, i risultati possono rivelarsi decisamente scadenti. “Meno sono gli esempi forniti ai modelli generativi, meno attendibili saranno i deepfake risultanti”, afferma Ramilli. Questo implica che la realizzazione di contenuti falsi di alta qualità richiede non solo competenze avanzate, ma anche una base solida di dati qualitativi.

È fondamentale sottolineare che, nonostante la crescente sofisticazione delle tecniche di generazione, la creazione di deepfake di livello elevato non è alla portata di chiunque. Persino i modelli avanzati possono generare contenuti inadeguati se non supportati da un training robusto. Pertanto, mentre il fenomeno deepfake rappresenta un pericolo significativo, non tutti sono in grado di produrre contenuti di alta qualità, limitando in parte il potenziale di ampliamento del problema.

Inoltre, la lotta contro i deepfake presenta le sue sfide. I metodi attualmente in uso per individuare contenuti falsi sono spesso inefficaci quando si tratta di deepfake di qualità superiore. Gli strumenti di fact checking, per esempio, possono verificare informazioni su un singolo contenuto, ma risultano inadeguati per quantità massicce di video o immagini che richiedono un grosso sforzo analitico. La tecnologia C2PA, sebbene promettente, è facilmente eludibile da chi desidera realizzare contenuti malevoli. Quindi, è evidente che la gestione del fenomeno richiede un approccio multifaccia, unendo tecnologie, strategia e competenze umane.

Alla luce di ciò, è chiaro che la battaglia contro i deepfake è complessa e in costante evoluzione. Adeguare le strategie di rilevamento e contrasto in funzione delle sempre più sofisticate tecniche di generazione è essenziale per affrontare un problema in continua espansione, rendendo indispensabile l’adozione di tecnologie avanzate come quelle sviluppate da IdentifAI.

L’importanza del fattore umano nella prevenzione

Anche in un’era in cui la tecnologia avanza a ritmi vertiginosi, il ruolo del fattore umano rimane cruciale nella lotta contro la disinformazione generata dai deepfake. Marco Ramilli, fondatore di IdentifAI, sottolinea il potere dell’essere umano nel riconoscere le sfide digitali e nel porre domande critiche relativamente ai contenuti che consuma quotidianamente. “L’essere umano ha ancora la capacità di porsi le domande giuste”, afferma Ramilli, enfatizzando che questa attitudine critica deve essere coltivata e sostenuta.

La crescente complessità e raffinatezza dei deepfake possono ingannare anche gli osservatori più attenti, rendendo essenziale che il pubblico sviluppi competenze di media literacy. La conoscenza dei segnali di avvertimento e delle tecniche utilizzate per creare falsi è fondamentale, perché anche le migliori tecnologie di rilevamento non potranno sostituire completamente il buon senso e l’innato scetticismo critico degli utenti. È quindi imperativo che l’educazione alla media literacy venga integrata nei programmi scolastici e nelle politiche pubbliche al fine di garantire che i cittadini siano ben equipaggiati per affrontare le sfide poste dalla disinformazione.

IdentifAI, da parte sua, si impegna a sviluppare non solo strumenti tecnologici, ma anche risorse educative destinate a formare gli utenti su come identificare i deepfake. Questa combinazione di tecnologia e consapevolezza umana rappresenta una risposta equilibrata e necessaria per affrontare un fenomeno in continua crescita. Ramilli afferma che, a lungo termine, gli esseri umani dovranno necessariamente affidarsi a strumenti di verifica per aggiungere un ulteriore livello di sicurezza, poiché i confini tra realtà e finzione diverranno sempre più sfumati.

Sebbene le tecnologie come quelle sviluppate da IdentifAI possano fornire supporto e protezione, la responsabilità di filtrare e contestualizzare le informazioni rimane in gran parte nelle mani degli individui. Solo un approccio olistico, che unisca alla tecnologia il potere del pensiero critico umano, potrà garantire una difesa efficace contro la disinformazione nel futuro prossimo.